人工智能是汽车行业的一项关键技术,而这涉及到复杂的后端计算,因此高速硬件在此至关重要。因为只有普及高性能计算机,才能在未来将各种新型技术量产化。“自动驾驶是要求最高的人工智能应用之一。”保时捷工程公司人工智能和大数据部门总监约阿希姆 · 舍珀博士(Dr. Joachim Schaper)解释说,“这些算法从非常多的案例中学习,这些案例是之前由测试车辆通过摄像头、雷达或其他传感器在真实交通运行中收集的。”

传统的数据中心越来越难以满足日益增长的需求。“截至目前,训练一个神经网络的单一变体需要几天时间。”舍珀解释说。因此他确信:汽车制造商需要借助各种新型人工智能计算技术,以使算法能够大幅加快学习速度。为了实现这一目标,必须在复杂的神经网络(深度神经网络,简称 DNN)中并行执行尽可能多的向量-矩阵乘法运算(请阅读第 35 页的信息栏)——这正是图形处理器(GPU)的专长。假如没有这些,近年来人工智能的惊人进步根本无法实现。

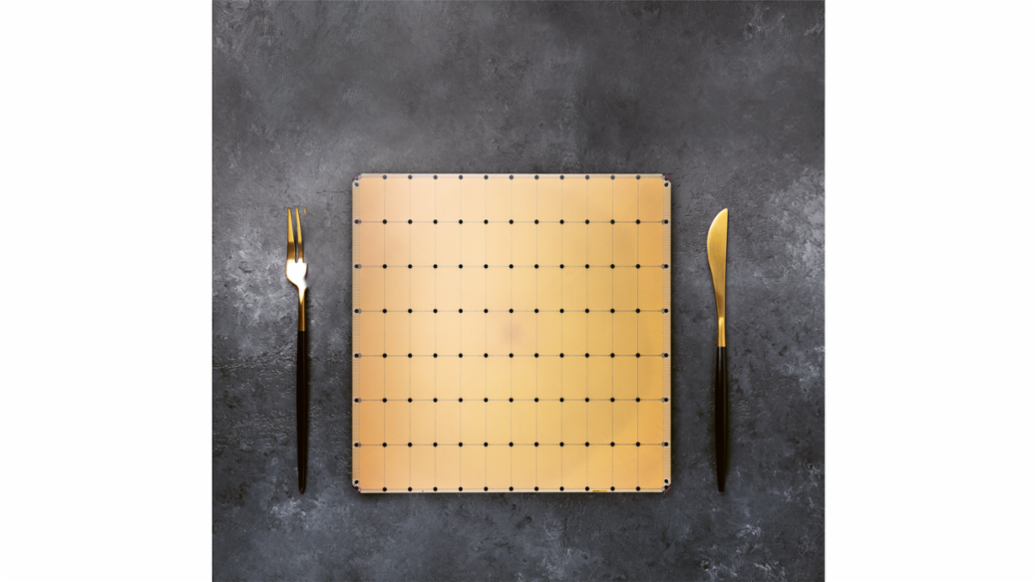

相当于 GPU 的 50 倍

然而,显卡原本并非为人工智能用途而设计,而是为了尽可能高效地处理图像数据。因此,当涉及到自动驾驶算法训练等应用时,它们愈加表现出局限性。所以,要想获得更快的计算速度,就需要专门针对人工智能的硬件。总部位于加利福尼亚州的Cerebras 公司提出了一种可能的解决方案。其“晶圆级引擎”(Wafer Scale Engine, WSE) 通过在一个巨大的计算机芯片上结合尽可能多的运算能力,从而可最佳满足神经网络的要求。它的体积是普通图形处理器的 50 多倍,可以容纳 85 万个运算核心,是目前顶级 GPU 的 100 倍以上。

此外,Cerebras 的工程师还利用高带宽数据线将运算核心相互联网:据制造商称,晶圆级引擎上的网络传输速率可达每秒 220 拍比特(petabit)。Cerebras 也拓宽了 GPU 内部的瓶颈。数据在主存储器和执行单元之间的传输速度,与较强大的 GPU 相比,也可达 1 万倍——每秒 20 拍字节(petabyte)。

为了节省更多时间,Cerebras 模仿了大脑的一种技巧。生物大脑中的神经元只有在接收到来自其他神经元的信号时才会工作。许多当前不活跃的连接不需占用任何资源。另一方面,在 DNN 中,经常发生向量-矩阵乘法以数字 0 为乘数的情况。这会花费不必要的时间。因此,晶圆级引擎将其忽略。“所有的零都被筛除。”Cerebras 在其关于 WSE 的白皮书中写道。换言之,该芯片只执行产生结果非零的运算。

但这种芯片的一个缺点是,它对电功率要求很高,达到 23 千瓦,这就需要进行水冷。因此,Cere-bras 开发了自己的服务器外壳,以供数据中心使用。在一些研究机构的数据中心,晶圆级引擎已经进入测试阶段。专家舍珀认为,这种来自加州的巨型芯片也有望加速汽车研发。“凭借这一技术,理论上需要一个星期的训练可以缩短到几个小时。”他估计道,“但这一技术还需要在实际测试中得到验证。”

以光代替电子

无论这款新型芯片有多么不寻常:与其以往的“前辈”一样,它也借助传统晶体管工作。一些公司,如美国波士顿的 Lightelligence 和 Lightmatter,希望利用速度明显更快的光来进行人工智能计算,以取代相对较慢的电子器件,并且正在为此打造光学芯片。因此,DNN 的工作速度有望“至少比电子式快几百倍”,Lightelligence 的开发人员写道。

“凭借晶圆级引擎,理论上需要一个星期的训练可以缩短到几个小时。” 保时捷工程公司人工智能和大数据部门总监 约阿希姆 · 舍珀博士(Dr. Joachim Schaper)

为此,Lightelligence 和 Lightmatter 公司利用了干涉现象。当光波相互加强或相互抵消时,就会形成亮-暗图案。如果以某种方式来控制干涉,新图案就对应于旧图案的矢量矩阵乘法。因此,光波可以“计算”。为了将这一理论实用化,波士顿的研发者们将微小的光导纤维蚀刻到一个硅芯片上。就像在纺织面料中一样,它们彼此交叉多道,而交叉点上会发生干涉。其间会以微小的加热元件控制光导纤维的折射率,使光波相互偏移。由此便可控制它们的干涉,从而进行矢量矩阵乘法。

然而,这家波士顿公司并没有完全摒弃电子技术。他们将自己的光学计算机与传统电子元件相结合,让后者负责存储数据,以及执行除矢量矩阵乘法之外的所有运算。例如,其中包括非线性激活函数,用于在移动到下一层之前修改每个神经元的输出值。

通过结合光学式和数字式计算机,DNN 的计算速度极快。“它们的主要优势是低延迟。”Lightelligence 发言人林赛·亨特(Lindsey Hunt)解说道。例如,这使 DNN 能够更快速地识别图像中的物体,如行人和电动滑板车骑手。在自动驾驶领域,这有望使系统在危急情况下更快做出反应。“此外,光学系统在消耗相同瓦特电能的情况下,可以做出更多决策。”亨特说。这一点尤为重要,因为车辆运算能力的提升,正越来越多地以牺牲油耗和续航里程为代价。

Lightmatter 和 Lightelligence 的解决方案可以作为模块装入传统计算机,以加速人工智能运算——类似于显卡。原则上,它们也可以集成到车辆中,例如用于实现自动驾驶功能。“我们的技术非常适合用作自动驾驶汽车的推理机。”林赛·亨特解释说。专家舍珀也持类似观点:“如果 Lightelligence 公司能够成功制造出适用于汽车的组件,则有望大大加快在汽车中引入复杂人工智能功能的脚步。”截至目前,该技术已准备上市:该公司计划于 2022 年与客户进行首批试点测试。

量子计算机作为人工智能加速器

量子计算机距离步入实际应用还要更遥远些。它们也可加快人工智能运算的速度,因为它们能够并行处理大量数据。为此,它们基于所谓的“量子比特”工作。与经典的信息量单位“比特”不同,量子比特可以同时代表 0 和 1 两个二进制值。这两个数字以叠加态共存,这只有在量子力学中才有可能。

“模式越复杂, 传统计算机就越 难加以分类。” IBM 欧洲和非洲量子研究部门负责人海克 · 瑞尔

量子计算机可能成为人工智能在对事物进行分类时的加速器,例如分类交通状况。其中会有许多不同的物体类别,包括自行车、汽车、行人、标志、潮湿和干燥路面。它们的区别基于诸多特性,因此专家们对“高维空间中的模式识别”产生了兴趣。

“模式越复杂,传统计算机就越难加以分类。”IBM 欧洲和非洲量子研究部门负责人海克·瑞尔 (Heike Riel) 解释说。因为每增加一个维度,计算两个物体相似度时的工作量就越大。正准备过马路的电动滑板车骑行者和使用助行车的老人,有多少异同?与经典计算机相比,量子计算机可以在高维空间中高效工作。对于某些问题,这一特性可能是有利的,使量子计算机相较于传统高性能计算机,可以更快地解决某些问题。

IBM 研究人员分析了可在训练后用于数据分类的统计模型。一系列初步结果表明,对于某些数据集,巧妙选择的量子模型比经典方法效果更好。量子模型更容易训练,而且似乎有更大的容量——这使它们能够学习更复杂的关联。

瑞尔承认,当今量子计算机可以用来测试这些算法,但它们与经典计算机相比,尚无真正优势。然而,量子计算机的研发进展迅猛。量子比特的数量和质量都在稳步提高。另一项重要因素是速度,以每秒电路层操作数(Circuit Layer Operations per Second,CLOPS)衡量。这个数字用于描述在单位时间内,量子计算机上可以运行多少个量子电路。它是量子计算机的以下三大重要性能标准之一:可扩展性、质量和速度。

在可预见的未来,量子计算机有望在某些应用中展现出优越性,也就是能够比传统计算机更快、更高效、更精确地解决问题。但是,要造就一台性能强大、纠错完毕、广泛通用的量子计算机,还要再多等待一阵。专家估计,至少还需要十年时间。但这份等待很可能是值得的。正如光学芯片或新型电子计算机架构一样,量子计算机可能成为未来交通出行的关键。

综述

在人工智能运算领域,目前不仅是传统微处理器,甚至图形芯片也已表现出局限性。因此,世界各地的企业和科研人员都在致力于寻求新型解决方案。接近实用化的是晶圆格式的芯片和光子计算机。再过数年,量子计算机也有望加入,以满足各种特别高的运算需求。

版权信息

本文初刊于保时捷工程杂志 2022 第 1 期。

作者:Christian Meier